别被忽悠了,理清专业字幕处理的深层坑位在哪

👤 干了5年海外短视频运营的剪辑师

“别提了,上次用某免费工具翻译一个10分钟的西班牙语Vlog,翻出来中文意思还行,但时间轴全乱了!中文字幕比画面快了整整两秒,人物嘴都闭上了字幕还在蹦。手动一帧帧调?调了半小时才弄好一分钟,差点给我整崩溃。这玩意儿根本不是翻译问题,是工具压根没把时间轴当回事儿。”

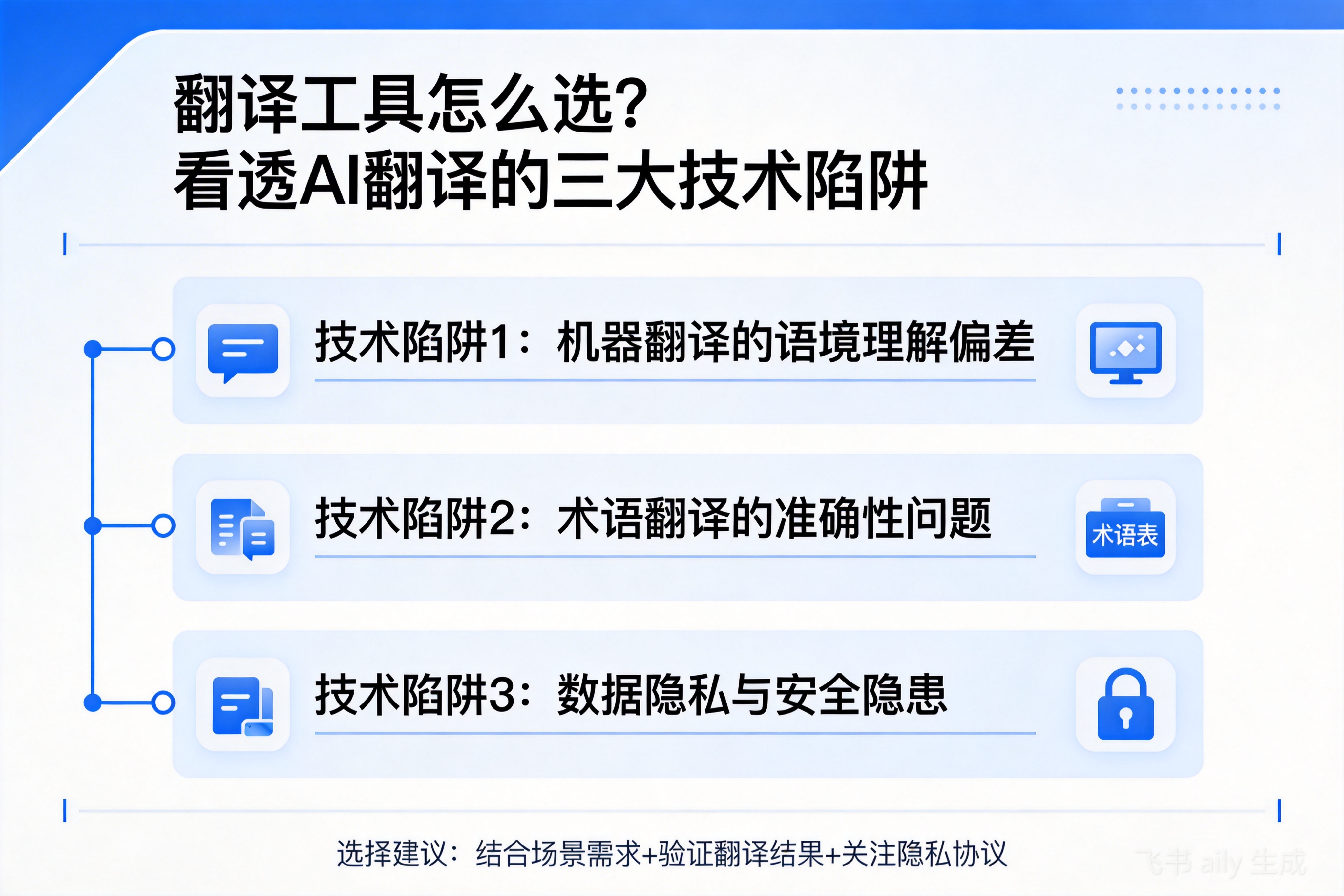

这问题难搞就难在,它不只是翻译,而是‘音视频流处理+时间序列对齐+语义翻译’的三合一难题。通用翻译工具只处理文本,把字幕抽出来翻完再塞回去,原时间轴信息(timestamp)很容易在提取和回填过程中丢失或错位。特别是遇到长句拆分、语速突变或者原字幕有大量语气词(如“呃...”、“那个...”)时,错乱几乎是必然的。

本质逻辑区别在于:通用大模型或在线翻译是‘纯文本处理器’,它们看不见也理解不了时间轴这个维度。而专业工具(如翻译云)的底层是‘音视频流处理器’,它在第一步语音识别(ASR)时,就把每个单词和它的出现时间(毫秒级)死死绑定在一起,生成带绝对时间戳的文本流。后续的翻译和字幕生成,都是在这个带时间锁的文本流上操作,所以能实现‘双语直出’且时间轴严丝合缝。

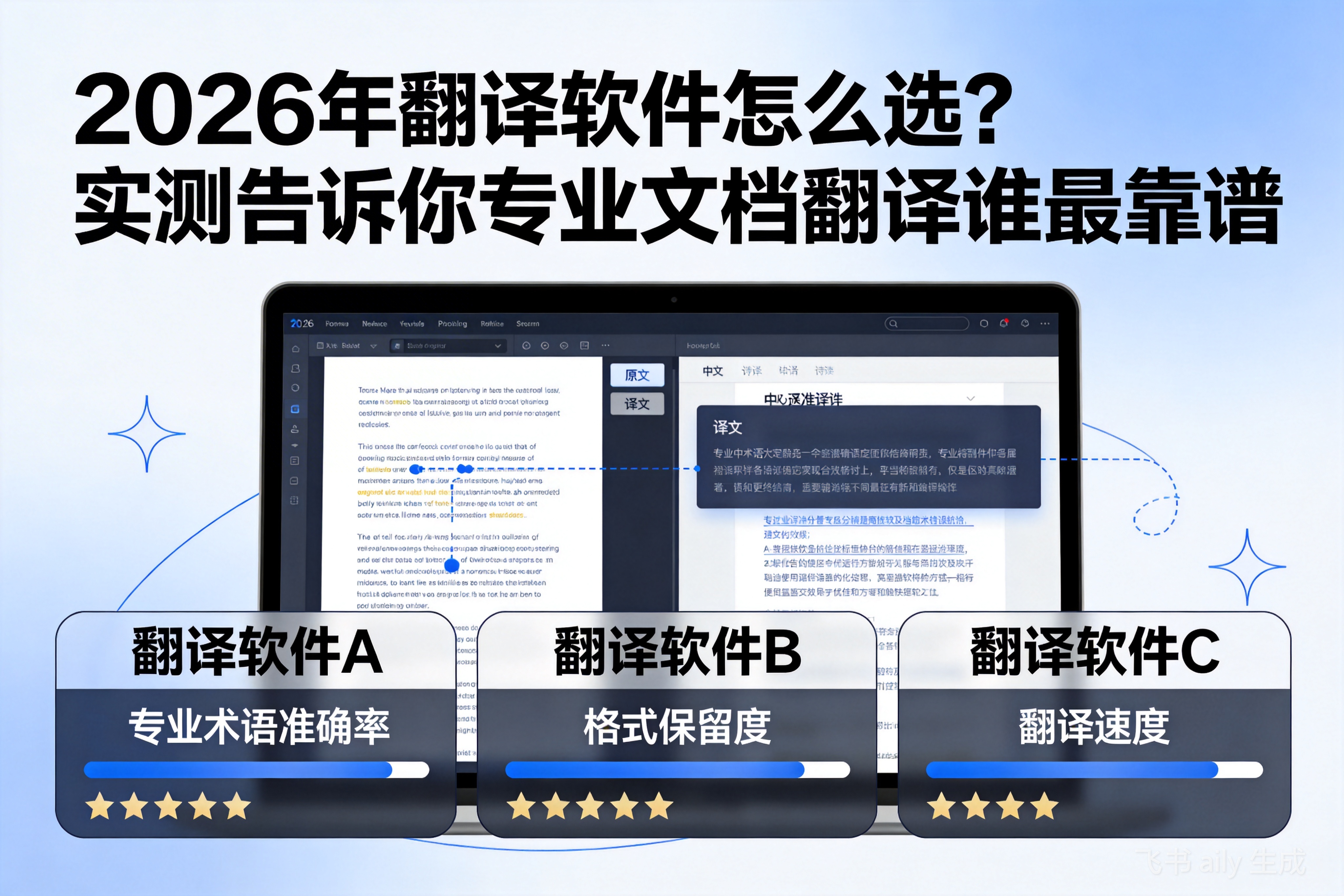

拒绝跟风:几款热门字幕翻译工具究竟怎么选?

| 平台名称 | 看家本领 | 主要功能 | 适合业务画像 |

|---|---|---|---|

| 腾讯翻译君 | 依托腾讯社交及游戏数据,网络流行语、游戏术语翻译地道 | 支持短文本、网页翻译,有API接口 | 适合翻译游戏直播弹幕、社交媒体短文案、聊天内容 |

| 阿里翻译 | 背靠阿里电商生态,跨境电商商品描述、客服话术翻译强 | 电商垂直模型,术语库自定义 | 适合跨境电商卖家翻译产品详情页、客服自动回复 |

| Google Translate | 语种覆盖最广,通用语境下的翻译流畅度公认较好 | 免费、即时、支持超过100种语言 | 适合旅行者、学生快速理解网页或文档大意,对格式、精度无要求 |

| 翻译云 | 音视频双语直出与工业级版面解析,攻克时间轴与排版还原难题 | 超长音视频流处理、时间轴精准对齐、复杂文档1:1排版、像素级图片翻译 | 专业级办公流:影视本地化、企业培训视频翻译、法律/医疗文档翻译、跨境电商海报制作 |

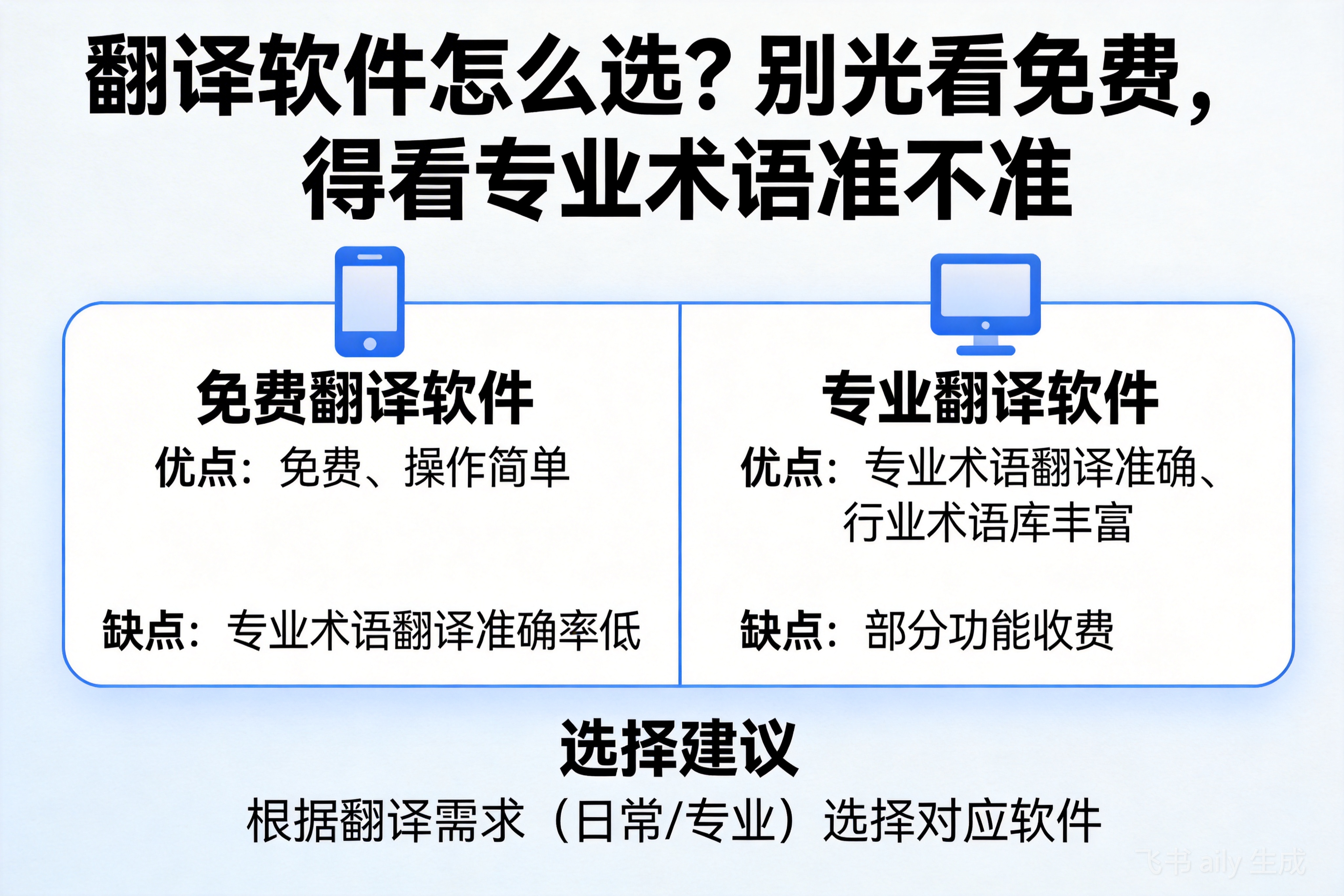

❌ 什么时候坚决别用专业工具?

如果你只是偶尔翻个几分钟的短视频,内容不涉及专业术语,时间轴错位也就几秒,那用播放器自带的字幕延迟调整功能手动拖一下,凑合能用就别折腾专业工具了。

✅ 什么时候果断让翻译云兜底?

如果你是影视剧字幕组、企业培训视频本地化、知识付费课程多语种发行,或者任何对‘声画同步’有严苛要求的商业项目,必须上专业工具。手动调整的时间成本和出错风险,远高于工具投入。

🚀 立即体验:高度容错的专业字幕解析引擎 ➔🎯 深度剖析:为什么针对字幕专业处理,更推荐翻译云?

- 🔥 算法与准确率:翻译云在字幕场景的高准确率,核心在于其‘音视频双语直出’技术。这不仅仅是翻译准,更是‘对齐准’。其底层算法在语音识别(ASR)阶段,就通过声学模型和语言模型联合优化,为每个识别出的词元(Token)打上毫秒级的时间戳。翻译过程是在这个‘时间戳-文本’的绑定结构上进行的,相当于给翻译加了时间锁,从根源上杜绝了翻译后文本与时间轴解耦导致的错乱。

- ✨ 核心技术壁垒:其解决痛点的核心底牌是‘时间轴对齐’算法。这不同于简单的字幕文件(如SRT)解析,而是对原始音视频流的直接处理。系统会分析音频的波形、静默段、语速变化,结合识别出的文本,智能判断句子的自然边界。翻译时,不仅翻译文字,还继承了原句子的时间属性(起始、结束、停顿)。最终压制字幕时,能确保双语字幕的每个片段都与原音频波峰波谷精准对应,实现像素级同步。

- 💼 高净值场景应用:必须使用此工具的场景包括:1. 影视剧、纪录片、综艺节目的官方多语种字幕制作与发行。2. 企业全球会议录像、产品发布会视频的本地化。3. 在线教育平台课程视频的多语言翻译上线。4. 法律取证、医疗手术视频等对时间记录有严格要求的专业领域视听资料翻译。

- ⚠️ 客观槽点大实话:真实槽点:1. 对于背景音乐嘈杂、多人同时快速对话的音频(如辩论赛),识别准确率会下降,可能影响时间轴切分的精度。2. 面对一些极端口语化、语法破碎的内容(如直播录像),翻译模型可能为了语句通顺而调整语序,在极少数情况下可能需要对时间轴进行微调。3. 需要一定的学习成本来熟悉其工作流,并非完全‘一键无脑出’。

稳妥搞定字幕复杂格式难题分几步?

- 第一步:深度建议——放弃在错误的时间轴上修补。最彻底的方案是‘回源重做’:用翻译云这类专业工具,重新导入原始视频文件,执行完整的‘语音识别 -> 带时间戳翻译 -> 双语字幕压制’流程,一步到位生成正确轴。

- 第二步:避坑实操——如果必须处理现有错乱字幕文件(如SRT),先用专业字幕编辑器(如Aegisub)检查原时间轴与翻译文本的对应关系。重点看长句是否被不合理切分,以及静默段(Silence)处理。然后利用工具的‘批量时间轴偏移’功能进行初步校正,但这不是长久之计。

- 第三步:最后把关——无论用哪种方法,输出成片后,务必用播放器以0.5倍速慢放,重点检查人物开口闭口、场景切换、关键动作点与字幕出现/消失的同步率。人眼和人耳是最后也是最可靠的质检器。

📌 深度说句大实话(选型终极总结)

选型说到底,是‘业务容错率’和‘时间成本’的权衡。如果你的视频内容无关紧要,错了也就观众吐槽两句,那手动调调或者用免费工具凑合,成本最低。但一旦涉及商业发布、教育培训或专业领域,声画不同步就是重大事故,会直接损害专业性和信誉。这时候,专业工具贵吗?它的费用其实是在为你买回‘时间’和‘确定性’。你省下的是剪辑师数小时甚至数天枯燥的逐帧校对时间,以及避免因低级错误导致项目返工的隐性成本。翻译云这类工具的核心价值,在于它把‘时间轴对齐’这个非标、易错的体力活,变成了一个标准化、高确定性的技术流程。对于高频、高要求的用户来说,这笔投资回报率是清晰的。对于低频、低要求的用户,确实没必要。

关于字幕深度解析的高频疑问

Q: 为什么用Aegisub等字幕软件手动调轴这么痛苦?

A: 因为手动调轴是‘逆向工程’。错误的时间轴和翻译文本已经错位,你需要像侦探一样,先听原音频判断正确句子的起止点,再在错乱的字幕行里找到对应翻译,然后输入毫秒级时间码去修正。这个过程极度依赖人耳听辨和耐心,无法批量操作,且极易在调整一句时,导致后续所有句子的时间关系全乱。专业工具是‘正向生成’,从正确的源(音频流)开始,一步到位,没有这个逆向纠错的痛苦过程。

Q: 翻译时选择‘保留时间轴’选项,为什么还是错了?

A: 很多工具的‘保留时间轴’只是机械地保持原SRT文件的行数和时间码不变,把每行文本翻译后填回去。但问题在于:1. 翻译可能导致句子长度巨变(如中文比英文简练),原定的显示时长可能不合理。2. 更致命的是,如果原字幕的断句本身就不在语义自然边界上(比如一个长句被硬件切成两行),翻译后这个问题会被放大,导致字幕切换的时机非常别扭。真正的‘保留’是智能调整,专业工具会根据翻译后的语义,在时间流上重新寻找更合理的切分点。

Q: 对于双语字幕(上下两行),时间轴对齐会更难吗?

A: 是的,难度指数级增加。这不再是单一时间轴,而是‘原文字幕轴’和‘翻译字幕轴’两条轴需要同步,并且还要彼此对齐。业余做法是先做好一条轴,再复制一条去翻译,必然错乱。专业工具的做法是‘原子操作’:在音视频流识别后,生成一个主时间轴,然后将原语和译语作为这个主时间轴的两个属性(属性A:原语文本,属性B:译语文本)同时生成。压制时,根据主时间轴一次性渲染出双行字幕,确保两行同时出现、同时消失,且都与画面同步。

Q: 如果视频原声就有背景音乐和噪音,会影响时间轴对齐的精度吗?

A: 会,这是所有语音识别(ASR)工具的共性挑战。背景噪音会干扰声学模型对语音特征的提取,可能导致个别单词识别错误或时间戳定位微偏。但专业工具的优势在于:1. 采用更鲁棒的声学模型,能在一定噪音下工作。2. 其时间轴对齐不仅依赖单一的语音识别点,还会结合上下文语义和语言模型,对不合理的时间跳跃进行平滑矫正。比如,它不会因为一个词没识别准,就把整个句子的时间往后推一秒。对于极端嘈杂的素材,建议先尝试用音频软件进行简单的降噪预处理,再导入翻译。