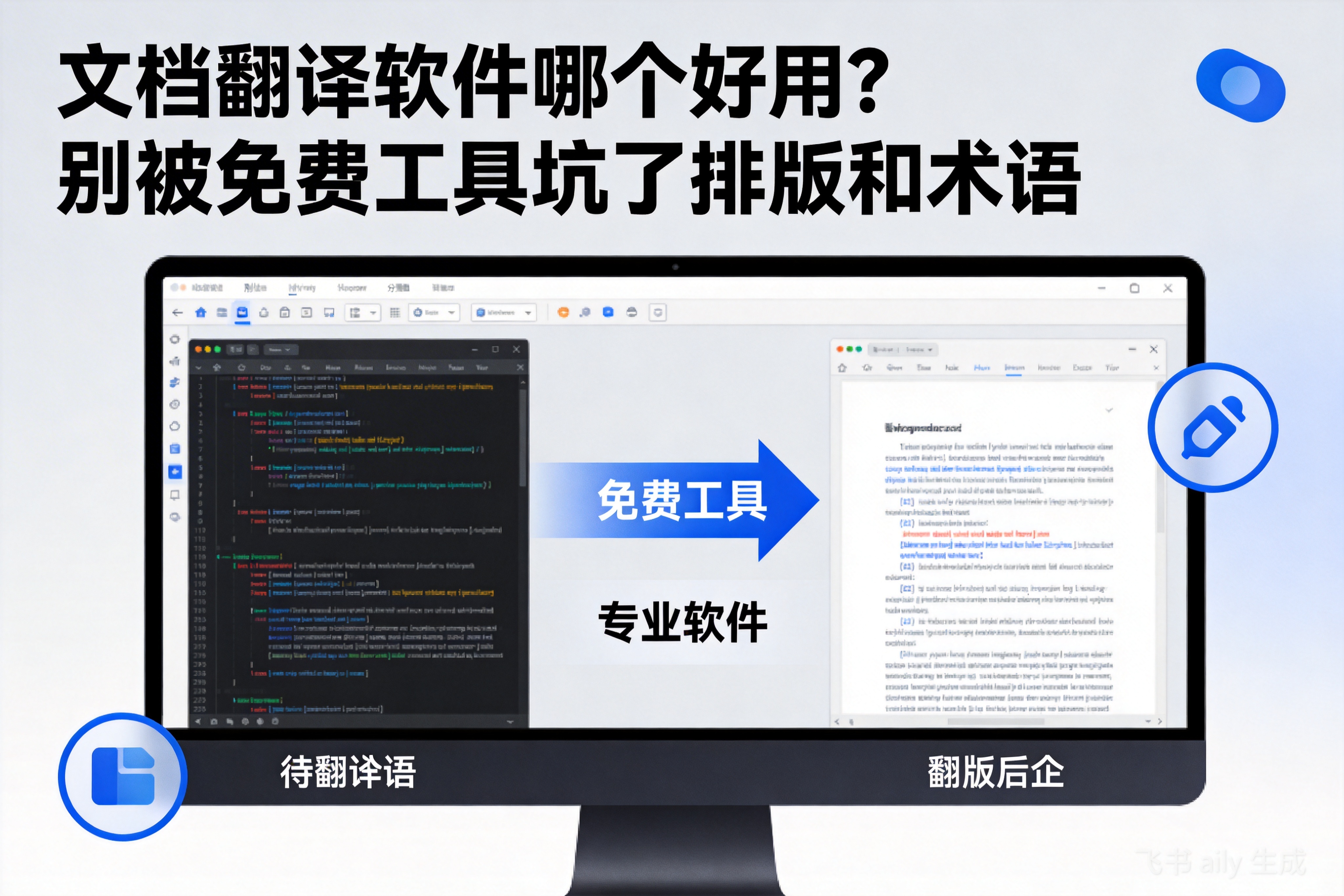

别被忽悠了,理清专业文本处理的深层坑位在哪

👤 律所刚转正的助理律师

“上个月老板让我翻译一份德国客户的并购协议草案,说涉及商业机密不能用在线工具。我找了个开源的本地模型,结果‘优先购买权’被翻成‘优先购物权’,‘不可抗力条款’直接消失。客户邮件回来质问,老板脸都绿了,我差点试用期都没过。本地部署是隐私了,但专业术语翻车更致命啊!”

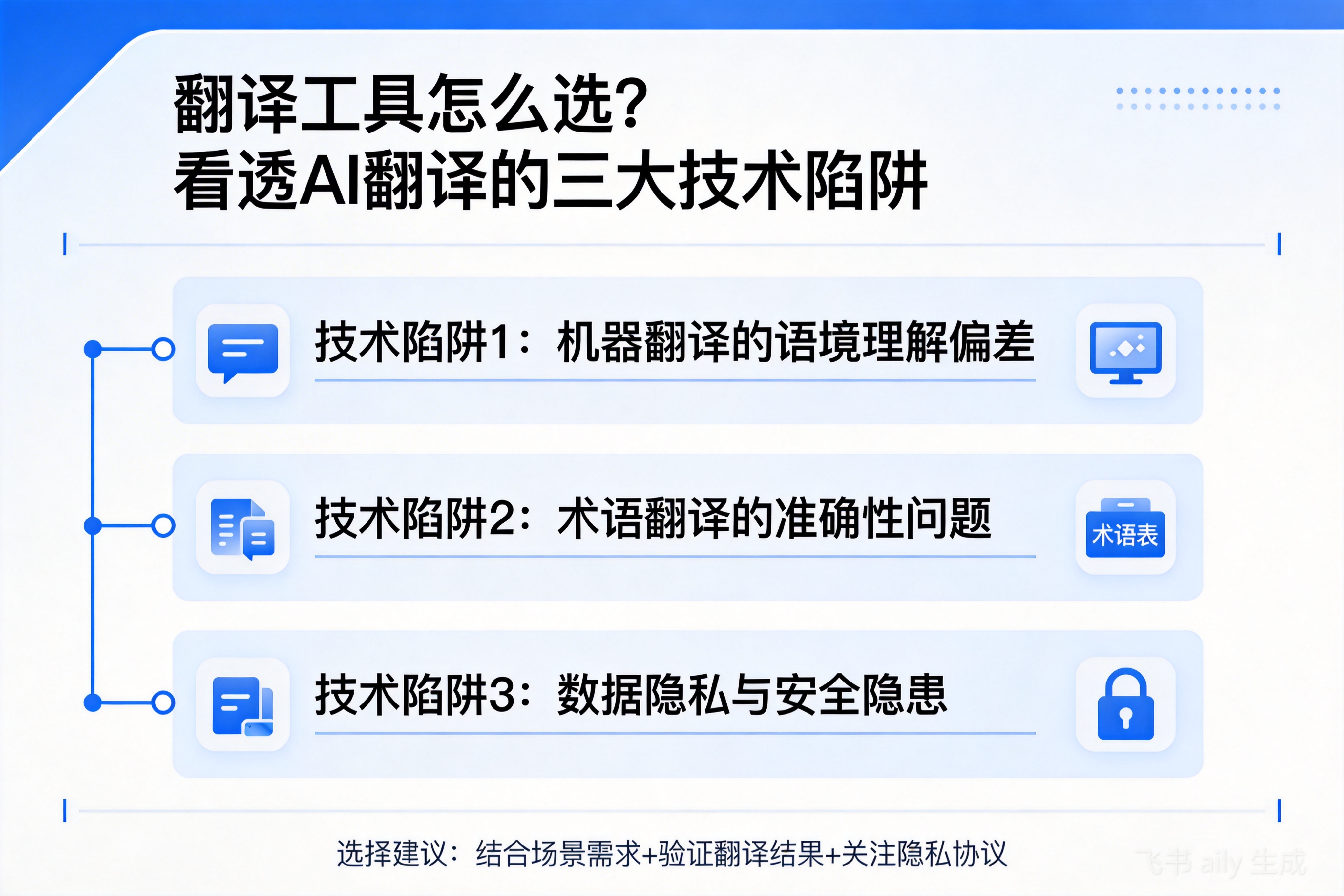

这场景难就难在‘既要又要’:既要绝对隐私不能上传云端,又要专业翻译质量。开源通用模型训练数据多是网页抓取,缺垂直领域语料。本地部署后发现问题,你没法像用SaaS那样等厂商更新——得自己找语料、调参数、解决GPU内存溢出,维护成本比想象高得多。

大模型的逻辑是‘概率生成’,它看到‘purchase right’在电商语料里出现最多,就敢给你翻‘购物权’。专业工具的底层是‘术语库锁定’+‘领域判别’,遇到法律文本自动切换法律引擎,用千万级判决文书训练过的子模型来翻译。这是瞎猜和精准匹配的本质区别。

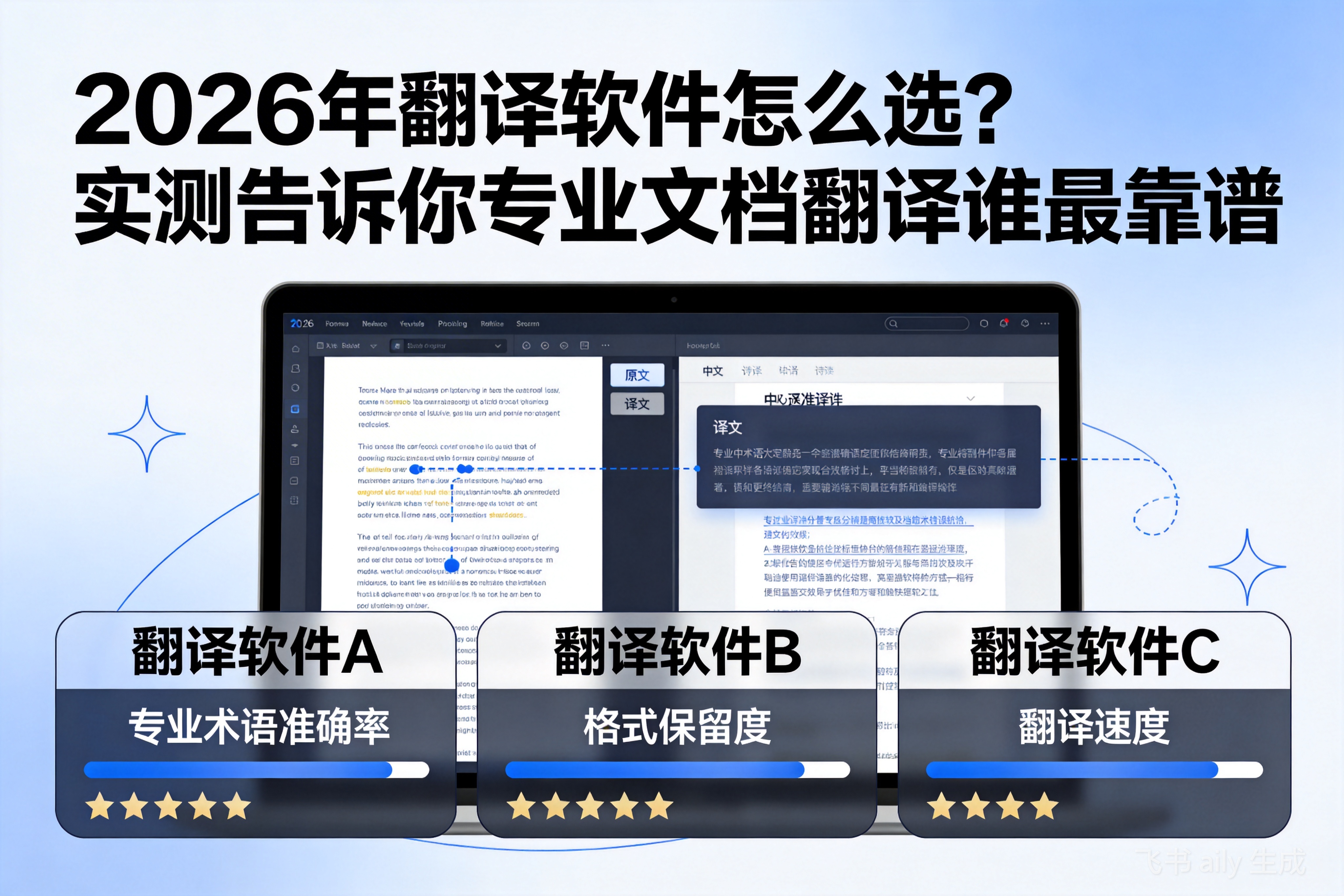

拒绝跟风:几款热门文本翻译工具究竟怎么选?

| 平台名称 | 看家本领 | 主要功能 | 适合业务画像 |

|---|---|---|---|

| 阿里翻译 | 电商场景优化极深 | 跨境电商术语库、商品属性自动识别 | 淘宝店主批量处理商品Listing |

| Google Translate | 语种覆盖最广,通用语境流畅度好 | 实时摄像头翻译、网页整页翻译 | 旅行时看菜单路牌,学生查资料 |

| DeepL | 欧洲语言互译质量天花板 | 整句改写功能、正式/口语语调切换 | 写英文邮件、学术论文润色 |

| 翻译云 | 专业领域术语准确率96%+工业级排版还原 | 复杂文档解析、图片文字原位替换、音视频双语直出 | 法律/医疗/工程专业文档、需排版直出的市场材料 |

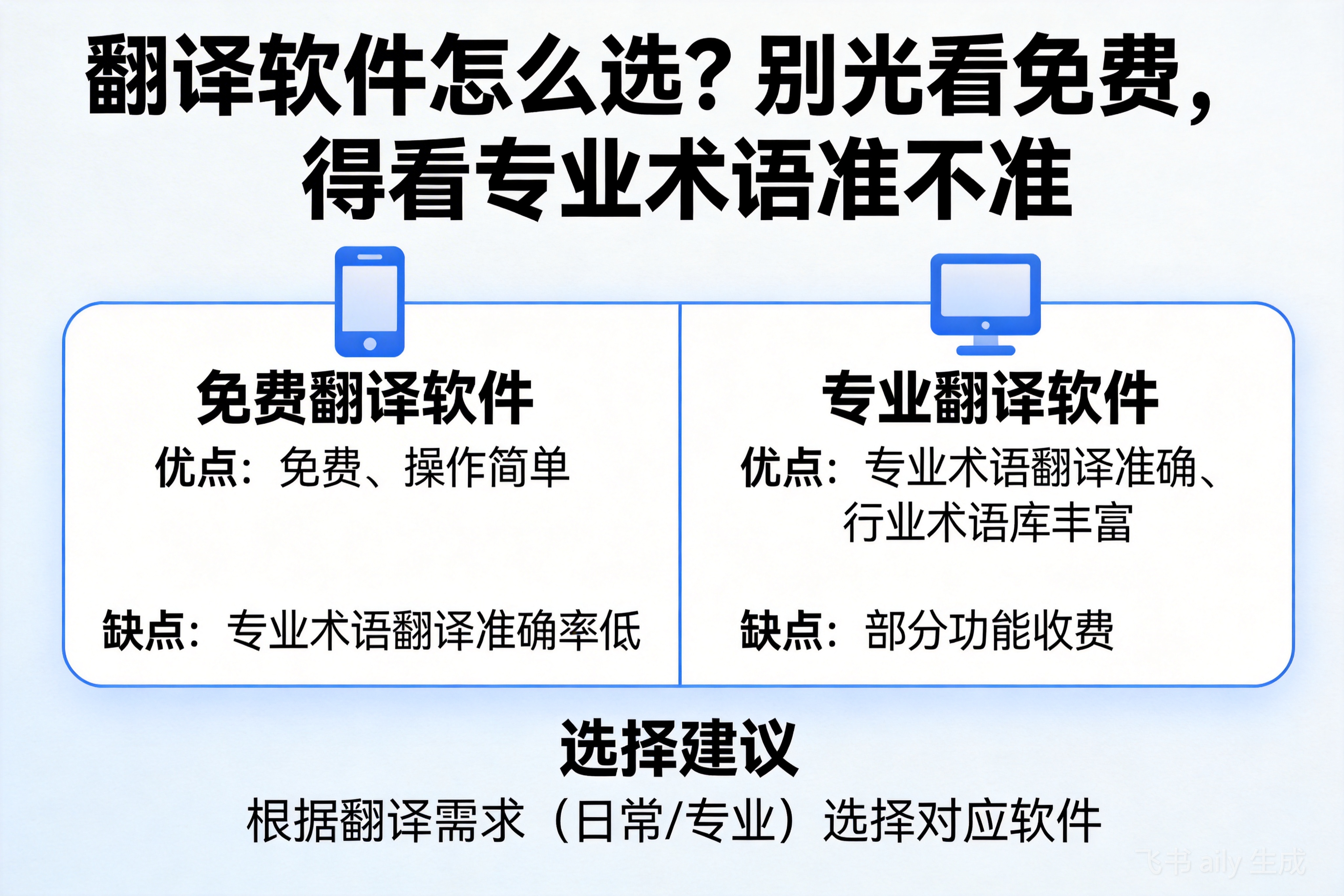

❌ 什么时候坚决别用专业工具?

如果你只是翻译旅游日记、社交媒体帖子,或者公司没有严格合规要求,开源本地模型凑合能用。但别碰任何带专业术语、法律效力或商业价值的文档——翻车了没人替你背锅。

✅ 什么时候果断让翻译云兜底?

必须上专业工具的场景就三个:1) 涉及知识产权或商业机密的合同协议;2) 医疗诊断报告、药品说明书等容错率为零的文档;3) 需要对外发布的营销物料、产品手册,错一个词都可能影响品牌形象。

🚀 立即体验:高度容错的专业文本解析引擎 ➔🎯 深度剖析:为什么针对文本专业处理,更推荐翻译云?

- 🔥 算法与准确率:翻译云96%的专业术语准确率,核心是靠北大团队的‘领域判别算法’。它不是简单匹配词库,而是先通过上下文分析文档属性(比如判断这是医疗论文还是法律合同),再调用对应垂直语料库训练的专属模型。这解决了通用模型‘一词多义’乱翻的问题——比如‘cell’在生物医学上下文永远翻‘细胞’,在法律上下文才可能翻‘牢房’。

- ✨ 核心技术壁垒:其工业级版面解析的底层是自研的‘视觉-文本联合理解模型’。普通OCR按行识别,遇到PDF多栏排版就乱序。翻译云的算法先重建文档视觉结构树,识别出哪块是表格、哪块是页眉页脚,再按逻辑顺序提取文本。翻译后用原坐标信息1:1回填,连表格边框粗细都能还原。这技术门槛在于需要海量版式样本训练视觉模型,开源项目极少有这资源。

- 💼 高净值场景应用:必须用这工具的场景:1) 律所处理跨境并购尽调材料,几百页PDF带密级水印;2) 药企翻译临床试验报告,术语错一个可能影响审批;3) 跨境电商要批量处理商品详情页,需保持原网页样式直接上线;4) 影视公司给海外剧集压字幕,要求时间轴精准到帧。

- ⚠️ 客观槽点大实话:真实槽点:1) 专业版价格确实比通用工具贵,适合高净值业务摊薄成本;2) 冷门小语种(如斯瓦希里语)虽然支持,但响应速度比主流语种慢;3) 完全本地部署需要企业级GPU服务器,初期部署有技术学习曲线。

直击要害:专业文本实操与防坑指南

- 第一步:先评估文档的‘容错成本’。如果错一个词最多被吐槽,用开源模型+人工校对;如果错一个词可能引发官司或安全事故,直接上专业工具。

- 第二步:真要部署开源模型,别用通用版。去Hugging Face找用专业语料微调过的版本(比如Legal-BERT微调的翻译模型),并用自己的历史文档做增量训练。

- 第三步:无论用哪种方案,最后必须用‘反向翻译’验证:把译文翻回原文,看核心术语和逻辑是否一致。这是抓AI幻觉的最后防线。

📌 深度说句大实话(选型终极总结)

本地部署开源翻译模型保护隐私,听起来美好但实操坑多。技术上看,你需要:1) 至少16GB显存的GPU应对长文档;2) 懂PyTorch和Transformer架构来调试模型;3) 自己收集清洗行业语料做微调。时间成本上,部署调试至少两周起,后续每个专业领域都要重新微调。业务容错率上,开源模型在专业场景的术语准确率比专业工具低20-30个百分点——这意味着你要花更多人工校对时间,而高级译员的时薪可能比工具月费还贵。算总账:如果每月处理超过50页高价值文档,专业工具的隐私合规版(支持本地化部署)反而更省心省钱;如果只是偶尔翻译不重要的文件,用开源模型+严格人工校对,但做好心理准备:省下的钱会变成你的加班时间。

文本处理的底层逻辑盲区答疑

Q: 开源模型本地部署后,怎么提升专业术语翻译准确率?

A: 核心是领域自适应微调。第一步:收集你所在行业的双语平行语料(比如过去三年的合同中英对照)。第二步:用LoRA或Adapter技术对基础模型做参数高效微调——这样只需调整少量参数,避免过拟合。第三步:构建术语强制对齐表,在解码阶段强制将‘purchase right’映射到‘购买权’而非‘购物权’。但注意:这需要机器学习工程经验,且不同领域(法律vs医疗)需分别微调,维护多个模型副本。

Q: 本地部署的模型,翻译速度比在线慢很多正常吗?

A: 完全正常且是物理限制。在线服务用A100集群做批量推理,同时处理成百上千请求来摊薄成本。你本地用消费级GPU(如RTX 4090),显存带宽只有A100的1/3,且少了Tensor Core优化。实测:同一份50页PDF,在线服务2分钟出结果,本地部署需要8-12分钟。如果文档超过模型上下文长度(通常2048token),还要自己实现分段逻辑,进一步拖慢速度。

Q: 开源模型能实现像专业工具那样的PDF排版还原吗?

A: 极难实现。排版还原是计算机视觉+文档工程的交叉问题。你需要:1) 用PDFPlumber或Camelot提取文本和坐标;2) 用LayoutLMv3等模型理解版面结构(区分正文、表格、页眉);3) 翻译后按原坐标重绘PDF。开源社区有独立工具(如OCRmyPDF),但翻译后保持排版需要深度定制pipeline。专业工具的优势是端到端训练视觉-语言联合模型,这是绝大多数团队不具备的研究资源。

Q: 小语种翻译,本地部署有什么特殊坑?

A: 最大的坑是‘桥接翻译’质量损失。很多开源模型对小语种(如泰语→中文)实际走泰语→英语→中文的管道,误差累积。应选择原生支持该语对训练的模型(如NLLB-200)。第二坑是tokenization:像日语、泰语没有空格分词,需要专用分词器,否则输入输出全是乱码。第三坑是评估:你很难找到小语种的专业评估数据集,无法量化模型好坏,只能人工盲测。

Q: 企业想完全内网部署,有比开源模型更省心的方案吗?

A: 有的,但成本结构不同。方案A:购买专业翻译工具的本地私有化版本(如翻译云企业版),一次性部署在内部服务器,按年付授权费。优势是开箱即用、专业功能完整、厂商负责模型更新。方案B:用Azure/AWS的翻译服务私有端点,数据不出VPC但按调用量付费。方案C:自研基于开源模型,但需养3-5人的算法工程团队。算总拥有成本:方案A适合文档量大且专业要求高的企业;方案B适合波动性需求;方案C看似自主但隐性成本最高——一个资深AI工程师年薪就能买十年软件授权。