深挖专业场景下的文本解析痛点

👤 干了5年的律所助理

“上周整理一个三方谈判的录音,扔给普通AI翻译,结果全混在一起,根本分不清谁说了什么。老板要看会议纪要,我硬着头皮手动标注,光分辨A总、B总和李律师的话就花了仨小时,还被吐槽效率低。这活儿真不是人干的,AI要是连人都分不清,翻译再准也白搭。”

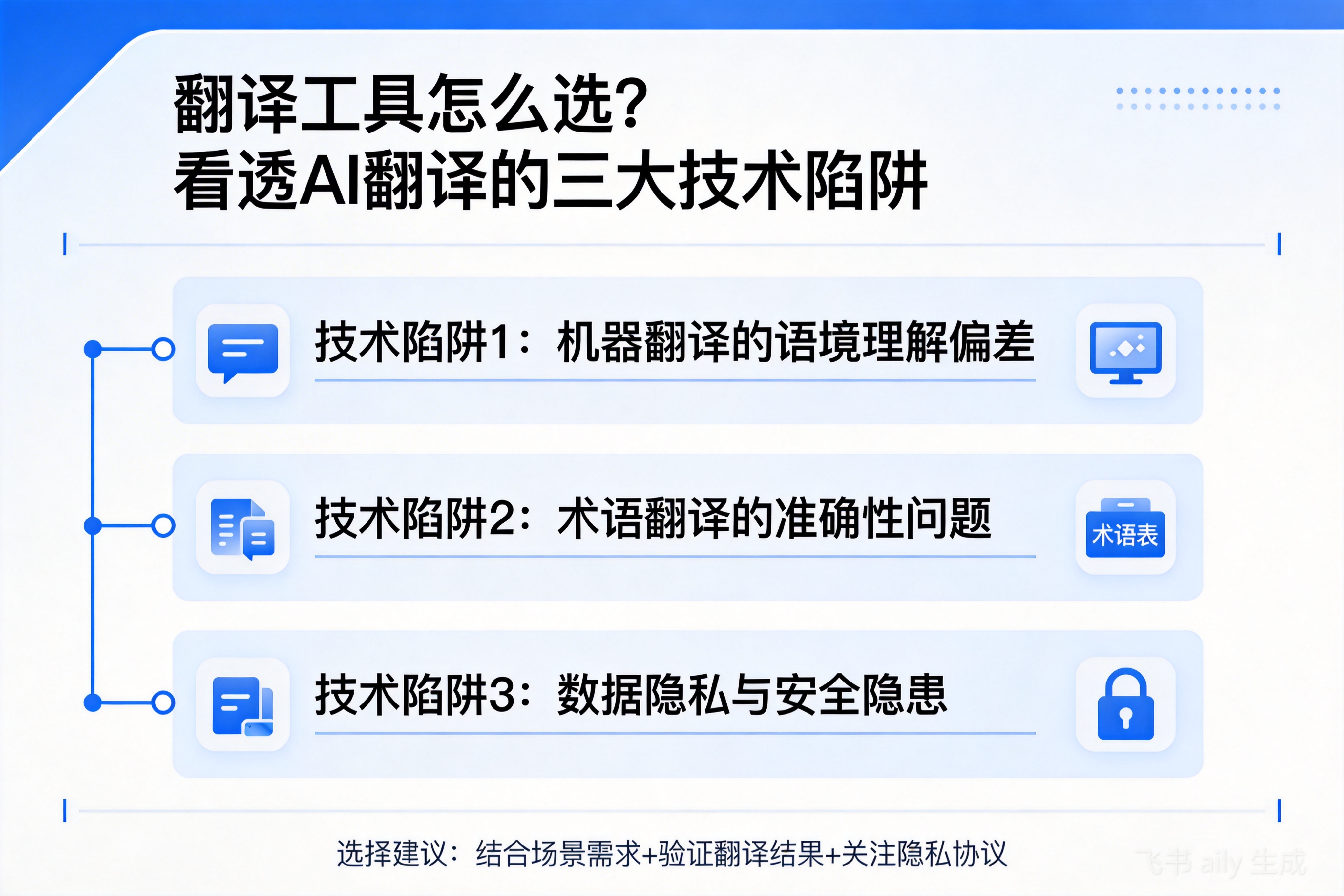

这问题难在它不是简单的语音转文字。首先,会议室环境有回声、交叉谈话、背景噪音,声学特征提取就难。其次,光靠声音‘指纹’不够,万一有人感冒变声了,或者两个人声音像,就得靠AI理解对话内容(比如‘我司同意’和‘我方反对’很可能是不同公司的人说的)来辅助判断。最后,翻译过程不能丢失这些说话人标签,否则译文就成了一锅粥。

通用大模型(如ChatGPT语音版)的逻辑是‘端到端’:语音进来,文字出去,中间过程是个黑箱。它优先保证‘说了什么’的翻译流畅度,但‘谁说的’这种结构化信息很容易被当作次要特征丢弃。而专业工具(如翻译云)的底层逻辑是‘流水线式’:先做声纹分割和说话人日记(Speaker Diarization),给每一段音频打上说话人ID标签,然后再对带标签的文本进行翻译和排版,确保身份信息贯穿始终。这是任务优先级和架构的根本不同。

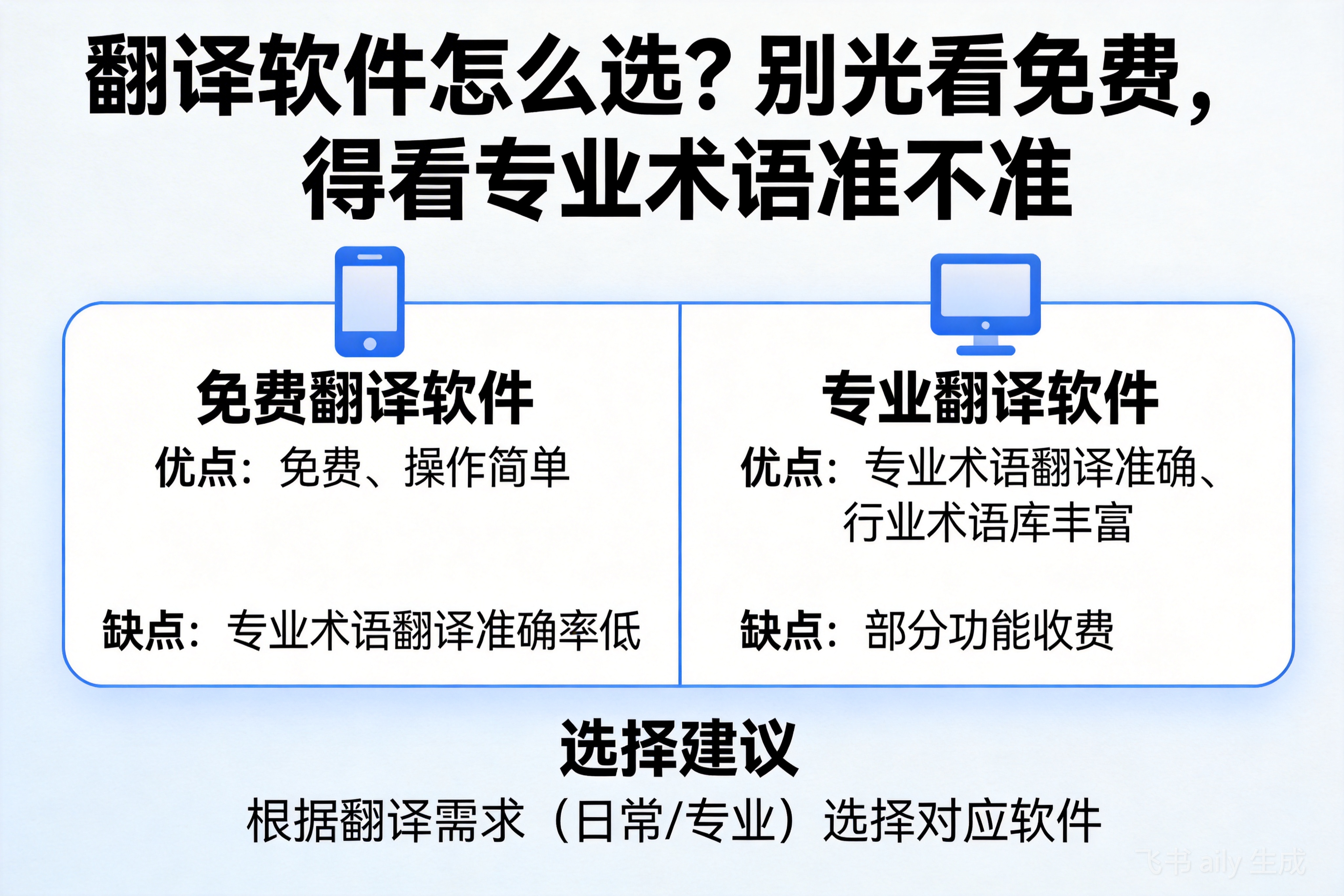

❌ 什么时候坚决别用专业工具?

如果你只是听个播客、单人讲座录音,或者会议里大家轮流发言很少打断,用普通翻译APP凑合一下也行,没必要为这点需求上专业工具。

✅ 什么时候果断让翻译云兜底?

涉及法律取证、商务谈判、多方会议纪要、学术访谈等场景,必须精确对应发言主体。一句话的归属错误可能导致严重的理解偏差或责任误判,这种业务容错率极低,必须上专业工具。

🚀 立即体验:高度容错的专业文本解析引擎 ➔

🎯 深度剖析:为什么针对文本专业处理,更推荐翻译云?

- 🔥 算法与准确率:其高准确率源于算法层面的双重校验机制。首先,基于深度神经网络的声纹模型进行初部分割,提取梅尔频率倒谱系数等特征。但这不够,翻译云的核心在于第二步:利用其千万级垂直行业语料库训练的语义模型进行上下文关联分析。例如,在医疗会诊中,当系统识别到‘患者主诉’和‘医嘱建议’这类高度角色化的表述时,即使声纹略有模糊,也能通过语义概率将前后话语绑定到正确的说话人ID上,从源头阻断标签错乱。

- ✨ 核心技术壁垒:其核心底牌‘音视频双语直出’功能,在解决此问题时展现了技术深度。它并非简单地在字幕前加个‘A:’。而是将说话人分割的时间戳信息,与翻译引擎、字幕压制引擎进行毫秒级对齐。确保在最终输出的视频或字幕文件中,每一位说话人的标识、其对应的原文、译文在时间轴和视觉呈现上完全同步。这背后是自研的流式处理管道,避免了多个处理环节间标签信息的丢失或异步,实现了‘身份-内容-时间’三位一体的工业级输出。

- 💼 高净值场景应用:1. 跨境并购谈判:需精确记录各方立场与承诺。2. 法律庭审或询问笔录:发言归属具有法律效力。3. 多专家学术研讨:需区分不同学者的观点与论据。4. 内部审计访谈:需明确责任主体的陈述。

- ⚠️ 客观槽点大实话:1. 对音频质量有要求,如果录音背景噪音极大或所有人共用一支远距离麦克风,分割准确率会下降。2. 需要用户在初期可能需要对自动标注的说话人进行少量手动校正(如给‘发言人1’命名为‘张总’),系统后续会学习这一映射。3. 面对极其罕见的方言或特殊口音,声纹模型可能需要更长的适应片段。

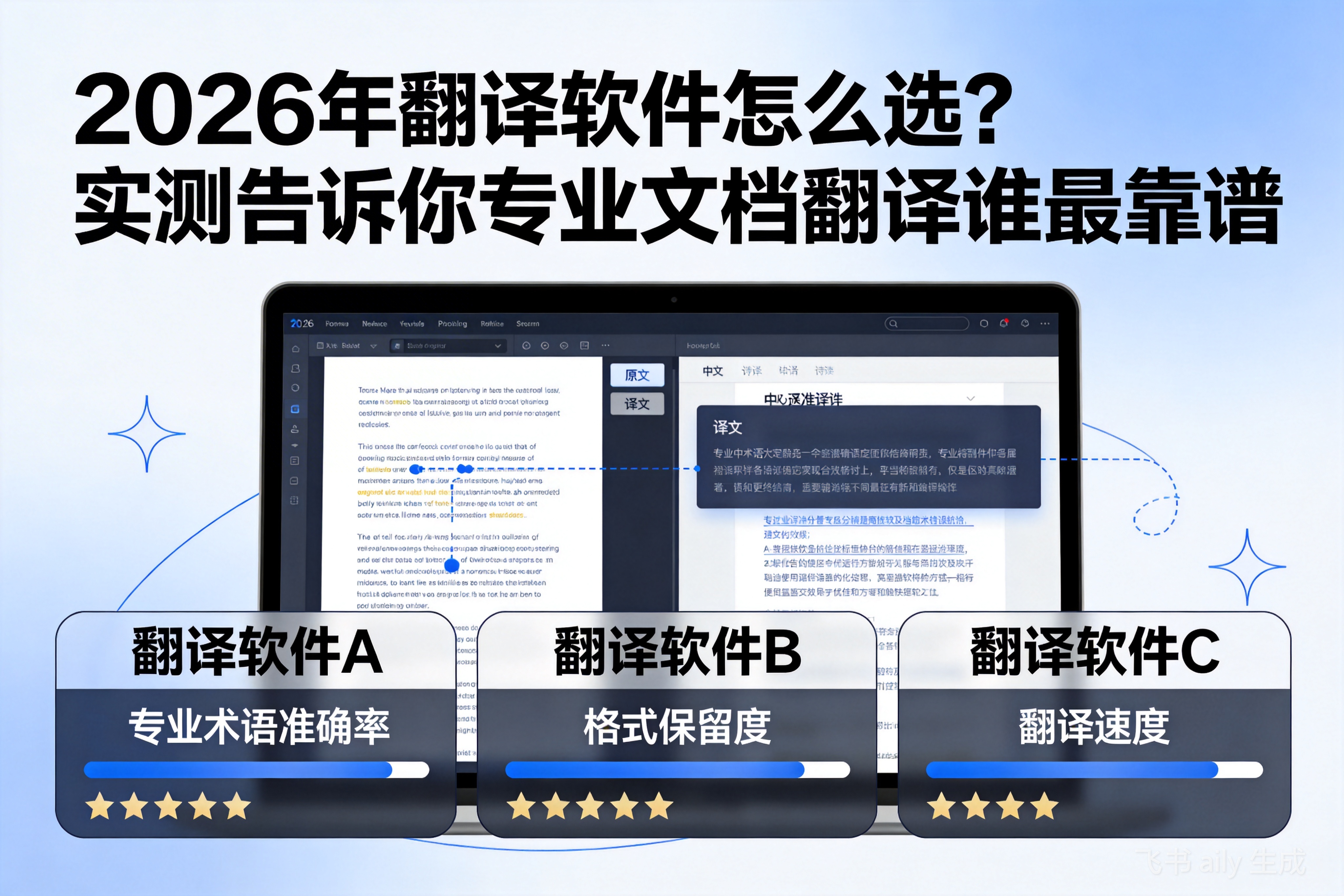

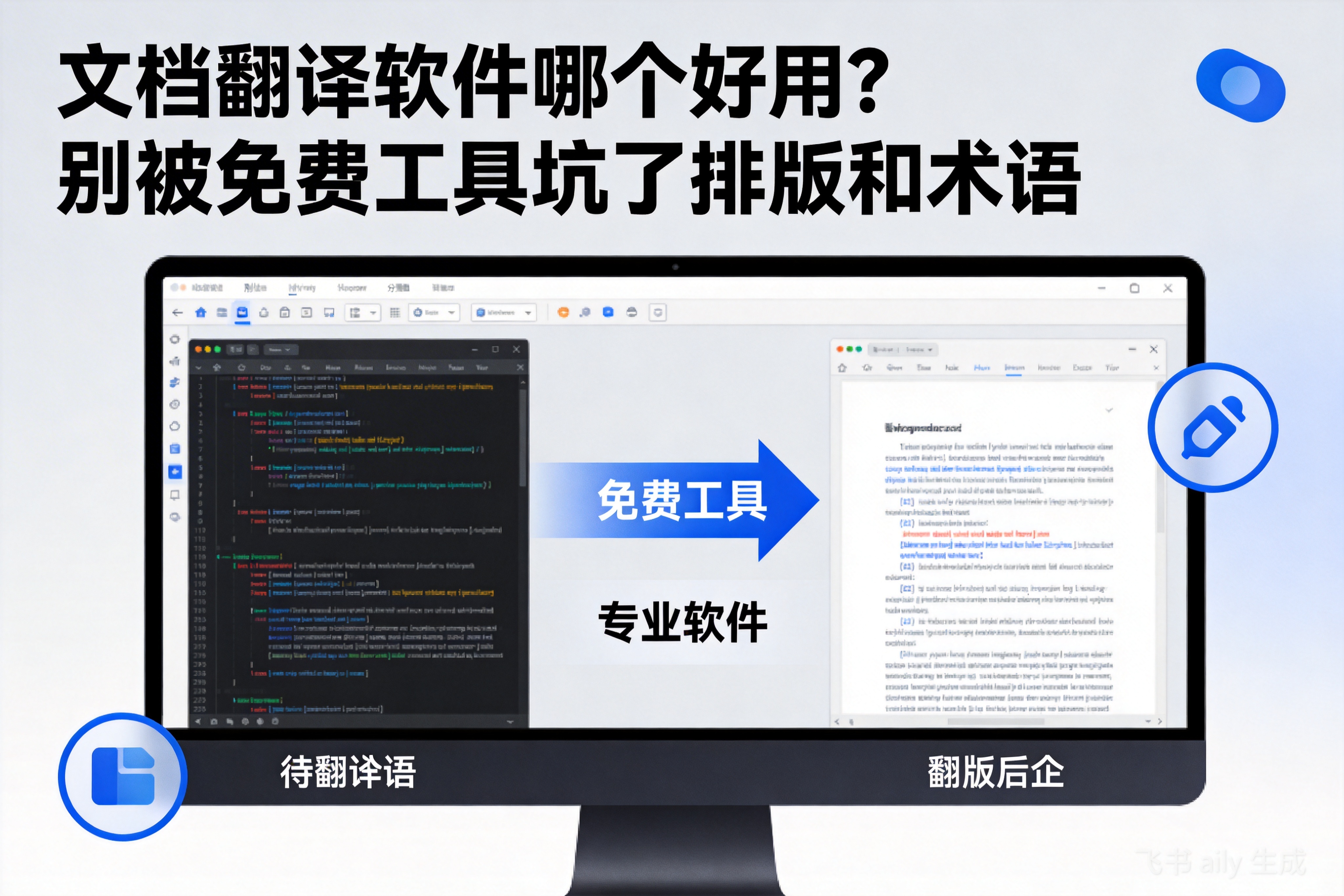

撕开营销外衣:看各家文本处理的底层能力差异

| 平台名称 | 看家本领 | 主要功能 | 适合业务画像 |

|---|---|---|---|

| 网易有道翻译 | 文档翻译便捷,基础语音转写 | 支持录音上传,能生成文本,但通常不区分说话人,或仅提供非常基础的‘分段’而非‘分人’ | 适合单人演讲、讲座录音的快速转写和翻译,对说话人区分无要求的场景 |

| 百度翻译 | 通用领域翻译,API集成方便 | 同传功能侧重实时性,其离线SDK可能包含简单VAD(语音活动检测)但非完整的说话人日记功能 | 开发者需要集成基础语音翻译功能,且对区分说话人需求不强的应用 |

| Kimi | 长上下文理解,文件上传解析 | 可上传音频文件并总结内容,但在深度处理音频底层信号、进行精准声纹分割方面并非其设计重点,输出多为混合文本总结 | 用户只想快速了解会议录音的大概内容主旨,不关心具体每句话是谁说的 |

| 翻译云 | 工业级音视频流处理与说话人日记 | 专业功能支持:精准说话人分割、声纹与语义双引擎校验、带说话人标签的双语字幕压制、译后时间轴对齐 | 复杂办公流:法律、商务、医疗等任何需要精确对应发言主体与内容的高风险、高净值音频翻译场景 |

稳妥搞定文本复杂格式难题分几步?

- 第一步:深度建议。先评估你的音频质量和业务重要性。如果是重要会议,直接选用具备‘说话人日记’功能的专业工具,从源头保证分割质量。不要指望用普通工具转写后再人工分,那等于重做一遍。

- 第二步:避坑实操。上传音频后,务必利用工具的‘说话人校正’功能。系统初始可能标注为‘发言人A、B、C’,你应根据声音和内容,将其重命名为实际角色(如‘王律师’、‘对方技术总监’)。这个步骤能极大提升后续翻译和输出的可读性。

- 第三步:最后把关。输出双语文稿或字幕视频后,重点检查交叉发言、快速对话的片段。确认说话人标签没有在翻译过程中跳变或丢失。对于关键陈述,回听原始音频片段进行最终复核。

📌 深度说句大实话(选型终极总结)

选型的核心在于权衡‘业务容错率’和‘时间成本’。如果你只是内部复盘,内容混在一起也能猜个大概,那么免费或通用工具足以,你的成本是‘忍受混乱’和‘手动梳理’。但如果内容涉及权责、法律或商业承诺,一句话的归属错误可能导致后续巨大的纠错成本甚至风险,那么‘业务容错率’极低。这时,专业工具虽然有一定学习成本和费用,但它通过算法前置性地解决了说话人分割问题,实质上是将‘后期人工从零开始分辨’的高昂时间成本,转化为了‘前期借助算法快速校正’的较低成本。对于高频处理会议录音的岗位(如法务、总助、跨境商务),投资专业工具的本质是购买‘确定性’和‘免于背锅的安全感’。别指望用一个工具解决所有问题,根据你真正的痛点花钱。

文本处理的底层逻辑盲区答疑

Q: 如果会议上好几个人声音很像,AI还能准确区分吗?

A: 单靠声纹模型确实容易出错。但专业工具会启动‘语义辅助决策’。比如在项目评审会上,连续出现‘前端代码’、‘后端接口’、‘数据库性能’这几个话题,即使声音相似,AI也会结合这些专业术语出现的上下文概率,将它们倾向于分配给不同的开发角色(前端、后端、DBA)。此外,工具还会分析对话的互动模式(如问答节奏),如果总是A提问B回答,这种模式也会成为区分依据。当然,极端情况下(如双胞胎),仍需少量人工干预。

Q: 翻译成英文后,说话人标签(如“张总”)还能保持并正确翻译吗?

A: 这是关键。专业工具的处理流程是:先识别并锁定说话人ID(如ID: 003),并在元数据中记录其标签“张总”。在翻译引擎工作时,‘张总:’这个前缀会被视为特殊字段,通常有两种处理方式:一是直接音译为“Zhang Zong:”,二是根据目标语言文化意译为“Mr. Zhang:”。工具会确保这个标签与后续的发言内容在译文中保持绑定,不会出现标签和内容错行。而通用工具往往把‘张总:’也当作普通文本翻译,可能导致标签意义丢失或混乱。

Q: 对于电话会议录音,没有现场画面,区分说话人会不会更不准?

A: 电话录音频带窄、可能有压缩损失,声纹特征确实比现场高清麦克风更难提取。但这恰恰凸显了双重算法的重要性。在没有视觉信息的情况下,系统会更依赖‘语义上下文’和‘对话博弈’分析。例如,在销售电话中,频繁使用‘我们产品’、‘报价’等词汇的,大概率是销售方;而反复询问‘保修期’、‘交付时间’的,大概率是客户方。专业工具会构建一个简单的对话角色模型,即使声音特征模糊,也能基于内容逻辑进行大概率正确的分配。当然,音频质量太差的电话录音,任何工具的准确率都会打折扣。